"لا يفهم العامية المصرية".. وثائق مسربة تكشف طريقة تعامل فيسبوك مع اللغة العربية

فيسبوك

كتبت- رنا أسامة:

كشفت وثائق داخلية مُسرّبة من فيسبوك أن المدققين البشريين والآليين لعملاق التواصل الاجتماعي يواجهون صعوبات عديدة في فهم اللهجات المتنوعة المستخدمة في جميع أنحاء الشرق الأوسط وشمال أفريقيًا، لاسيّما العاميّة المصرية، بحسب دراستان أجرتهما الشركة العام الماضي.

وقالت الدراستين، وهي عبارة عن سرد مفصل لآلية التعامل مع اللغة العربية عبر فيسبوك، إن المِنصة حصدت نجاحًا أقل على صعيد فهم ومراقبة المحتوى العربي.

كانت فيسبوك أزاحت الستار عن دعمٍ جديد للغة العربية عام 2009، وبعدها بفترة وجيزة نالت الخدمة استحسانًا لما لعبته من دور هام في الاحتجاجات الشعبية المعروفة بـ"الربيع العربي".

وبحلول العام الماضي، حلّت اللغة العربية في المرتبة الثالثة من حيث أكثر اللغات انتشارًا عبر هذه المنصة الاجتماعية، حيث يقضي الأشخاص في الشرق الأوسط وشمال أفريقيا وقتاً أطول كل يوم مع خدمات فيسبوك مقارنة بالمستخدمين في أي منطقة أخرى، وفق الدراسة التي أبرزها تقرير لمجلة "وايرد" الأمريكية.

"لغات مُبهمة"

ففي هذه المنطقة التي تعاني من عدم الاستقرار السياسي، تفرض فيسبوك بشكل خاطئ رقابة على المنشورات المعتدلة زعماً أنها تروج للإرهاب بينما تعرّض المتحدثين باللغة العربية لخطاب الكراهية الذي ينبغي ألا يظهر لهم.

وأكدت الدراسة المذكورة أن "اللغة العربية هي ليست لغة واحدة فقط"، مُبيّنة أنه موضحة "من الأفضل اعتبارها مجموعة من اللغات، العديد منها مُبهمة".

وأشارت المجلة إلى أن هذه الوثائق الدالة على النقص الذي يعاني منه فيسبوك بخصوص اللغة العربية ليست سوى جزءاً من مجموعة المواد المتاحة في الشركة، تُعرف مجتمعة باسم" أوراق فيسبوك".

وتُظهر هذه الوثائق أن فيسبوك تكافح – أو ربما تتجاهل – لإدارة منصتها في أماكن بعيدة عن مقرها الرئيسي في ولاية كاليفورنيا الأمريكية، أو بالأحرى في تلك المناطق حيث تعيش الغالبية العظمى من مستخدميها.

وتقع العديد من هذه الأسواق في أجزاء محرومة اقتصاديًا من العالم، تعاني من مختلف أنواع التوتر العرقي والعنف السياسي التي غالبًا ما تساهم وسائل التواصل الاجتماعي في تضخيمها.

كانت الوثائق المذكورة قد عُرضت على لجنة الأوراق المالية والبورصات وقدمت إلى الكونجرس الأمريكي في صيغتها المنقحة من قبل فرانسيس هوجين، المستشار القانوني السابق لدى فيسبوك. وتم تدقيق النسخ المُنقحة من قبل مجموعة من المؤسسات الإخبارية ، بما فيها مجلة "وايرد".

ومع أن "أوراق فيسبوك" تقدم نظرة محدودة على ما يجري داخل هذه الشبكة الاجتماعية، لكنها تكشف ما يكفي من الحقائق التي توضح التحدي الماثل أمام الشركة نتيجة إحرازها نجاح كبير.

فقد اُطلّق فيسبوك في البداية كموقعٍ إلكتروني مخصص لتصنيف مظهر الطالبات في جامعة هارفارد، وسرعان ما تحول إلى منصة عالمية يستخدمها ما يقارب 3 مليارات شخص، يتحدثون أكثر من 100 لغة.

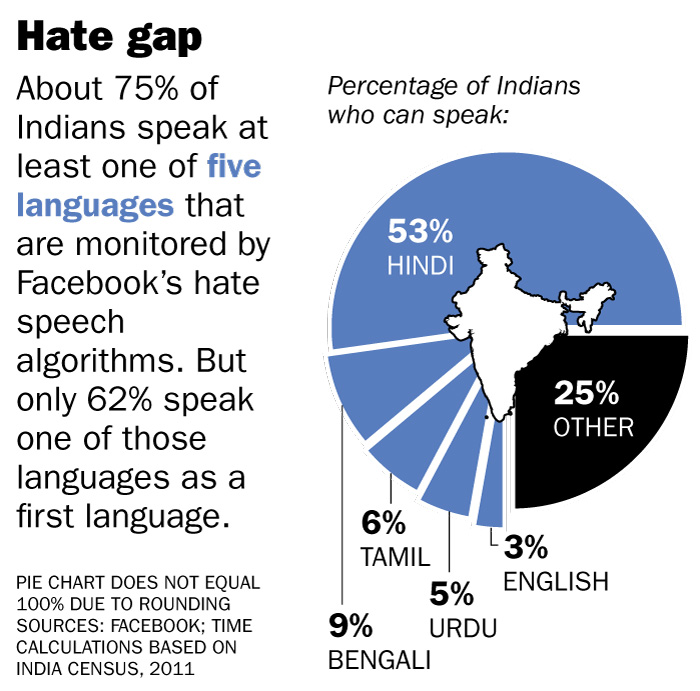

ويعد تنظيم مثل هذه الخدمة بشكل مثالي أمرًا مستحيلاًا لكن الحماية التي توفرها الشركة لمستخدميها تبدو غير متكافئة بشكل خاص في البلدان الفقيرة، لا سيما أن مستخدمي فيسبوك الناطقين بلغاتٍ مثل العربية أو الباشتو أو الأرمينية هم في الواقع مواطنون من الدرجة الثانية في أكبر شبكة اجتماعية في العالم.

بحسب ما جاء في الوثائق المذكورة، تتضمن بعض إخفاقات فيسبوك مشاكل تقنية ليس من السهل إيجاد حلول لها. لذا، تلجأ الشركة إلى الذكاء الاصطناعي لمساعدتها في إدارة المحتوى المثير للمشاكل؛ إذ لا يتمكن الموظفون البشريين في فيسبوك مراجعة كل مشاركة.

الخوارزميات لا تفهم "فروق" في اللغة

بيد أن علماء الكمبيوتر يقولون إن خوارزميات التعلم الآلي لا تفهم حتى الآن الفروق الدقيقة في اللغة. ويبدو أن أوجه القصور الأخرى تعكس اختيارات فيسبوك بخصوص مكان وحجم الاستثمارات، لا سيما بعد أن وصلت أرباحها في العام الماضي إلى أكثر من 29 مليار دولار.

فعلى سبيل المثال، تقول الشركة أن ما يقارب ثلثي مستخدمين موقع فيسبوك يتحدثون لغة أخرى غير الإنجليزية التي يُعتمد عليها في تنظيم المحتوى في مختلف أرجاء العالم.

وأفاد الناطق باسم فيسبوك، بأن الشركة توظف لديها 15 ألف مدقق للمحتوى بأكثر من 70 لغة، وقد نشرت معايير المجتمع الخاصة بها في 47 لغة مختلفة. ومع ذلك، يقدم فيسبوك خدمته بأكثر من 110 لغة، ولا يزال المستخدمون ينشرون بلغات إضافية، بحسب المجلة.

خطاب الكراهية

على صعيد آخر، حذرت مذكرة صادرة في ديسمبر من العام الماضي، بشأن مكافحة خطاب الكراهية في أفغانستان، من عدم تمكن المستخدمين من الإبلاغ بسهولة عن محتوى إشكالي نظراً لأن فيسبوك لم تترجم معاييرها إلى لغة الباشتو أو الداري، وهما اللغتان الرسميتان للبلاد، بل اكتفت بترجمة جزء من النماذج الإلكترونية الخاصة بالإبلاغ عن خطاب الكراهية إلى هاتين اللغتين، مع تقديم العديد من الكلمات باللغة الإنجليزية.

وعلاوة على ذلك، أكدت المذكرة أن ترجمة فيسبوك لمصطلحات خطاب الكراهية بلغة الباشتو "لا تبدو دقيقة" رغم أنها اللغة المتداولة على نطاق واسع في باكستان.

من جانبه، أكد المتحدث الرسمي باسم الشركة في بيانٍ أن "فيسبوك تهدف من خلال مكافحة خطاب الكراهية عبر موقعها إلى الحد من انتشاره، وهذا ما يلمسه الأفراد بالفعل".

وبحسب الأرقام التي كشفت عنها الشركة مؤخرًا، انخفض المعدل الوسطي لهذا الخطاب في جميع أرجاء العالم منذ منتصف 2020، الأمر الذي "يعكس جهودنا الشاملة المبذولة لحذف التعابير التي تحض على الكراهية لأي شركة تكنولوجيا استهلاكية كبرى. ولا يزال أمامنا الكثير من العمل للتعبير عن التزامنا المستمر بتحقيق هدفنا هذا على النحو الصحيح"، وفق البيان.

أخطاء "مضمونة فعليًا"

وبالحديث عن اللغة العربية، تُجرى معظم عمليات مراجعة محتوى فيسبوك في الدار البيضاء بالمغرب، وفق ما أكدته إحدى الوثائق، بواسطة موظفين معينين محلياً. وهذا يعني أن الأخطاء عند التعامل مع المحتوى من خارج شمال أفريقيا "مضمونة فعليًا"، وفق الوثيقة.

بيد أنه، وحتى في لهجات شمال أفريقيا، فإن الأخطاء تمثل مشكلة. وفي هذا الصدد، استشهدت الوثائق – بحسب المجلة- بقضية حسام السكري، رئيس قسم اللغة العربية سابقاً في محطة "بي بي سي"، والذي وجد نفسه في عام 2020 غير قادر على البث المباشر عبر فيسبوك وأعزت الشركة السبب إلى منشور ظهر عام 2017 باللغة العربية لانتقاد رجل دين مسلم محافظ وهدف إلى الترويج للإرهاب.

ووضعت الخوارزميات علامة على المنشور لخرقه قواعد فيسبوك ووافق المراجعون البشريون على ذلك، بحسب تقرير سابق بصحيفة "وول ستريت جورنال" الأمريكية. وأُغلق بعدها حساب السكري بعد أن أبلغه فيسبوك أن العديد من منشوراته الأخرى تنتهك سياساته.

وقالت الوثيقة إن الشركة أجرت تحقيقاً ووجدت أن الموظفين الذين راجعوا "مجموعة" من مشاركات السكري اتخذوا إجراءات خاطئة ضدها بنسبة تصل إلى 90 في المائة.

بدوره، أشار المتحدث الرسمي باسم فيسبوك إلى أن الشركة أعادت إظهار منشورات السكري بعد أن علمت بحذفها عن طريق الخطأ؛ إذ تقوم فيسبوك بمراجعة الخيارات المتاحة بهدف التغلب على التحديات الخاصة بالتعامل مع اللهجات العربية، وتلجأ إلى توظيف المزيد من مراجعي المحتوى من أصحاب المهارات اللغوية المتنوعة.

خوارزميات "المحتوى الإرهابي"

علاوة على ذلك، تؤكد الوثيقة المخصصة لمراجعة مدى اعتدال فيسبوك في الشرق الأوسط وشمال أفريقيا من شهر ديسمبر 2020 ، أن الخوارزميات المستخدمة للكشف عن المحتوى الإرهابي باللغة العربية تُخطئ بنسبة 77 بالمائة، وهذه نسبة أسوأ من التخمين. وقال المتحدث باسم فيسبوك إن الرقم خاطئ، وأن الشركة لم ترَ دليلًا على هذا الأداء الضعيف.

كما حذرت الوثيقة من أن الإبلاغ عن عدد كبير جداً من المنشورات المحرّضة على الإرهاب قد يعود بالضرر على مطامح شركة فيسبوك.

وكشفت أحدث تقرير لأرباح للشركة أن الإيرادات الخاصة بكل مستخدم قد سجلت نمواً بشكل أسرع ضمن فئتها الجغرافية التي تشمل الشرق الأوسط. وتوضح الوثيقة أنه عندما عارض أصحاب حسابات المعلنين التي تم تعطيلها قرار فيسبوك، ثبت أن ما يقارب نصف هذه الحسابات قد تم إغلاقها بشكل غير صحيح، وهذا ما يشير إلى أن مشاهدات الفيديو وسجلات النمو في المنطقة مقيدة بسبب معاقبة الحسابات بشكل خاطئ.

بدورها، قالت رشا عبدالله، الأستاذة في الجامعة الأمريكية بالقاهرة والمتخصصة في دراسة وسائل التواصل الاجتماعي، إن "نتائج أبحاث فيسبوك تؤكد شكوك الغرباء بأن الشركة تلغي المحتوى البريء أو المهم، مثل النكات والتغطية الإخبارية والنقاش السياسي".

"نظام الأتمتة"

واعتقدت أن المشكلة قد تفاقمت حين قامت الشركة باعتماد المزيد من الأتمتة، مُضيفة: "بدأنا نشهد مثل هذه المشكلات في السنوات الأخيرة بالتزامن مع زيادة استخدام الخوارزميات وتقنيات الذكاء الاصطناعي".

ولا شك أن الاعتماد المتزايد على الخوارزميات يقع في صميم إستراتيجية فيسبوك للإشراف على المحتوى. فقد صرّحت الشركة مؤخراً أن التعلم الآلي قد قلل من عدد المرات التي يواجه فيها مستخدمو فيسبوك خطاب الكراهية، إلا أن الشركة لا تكشف عادةً عن أي بيانات متعلقة بأداء التقنيات المعتمدة من قبلها في مختلف البلدان أو اللغات.

وفي وقت سابق من الشهر الجاري، وافقت فيسبوك على إجراء فحص مستقل حول المحتوى المعتدل باللغتين العربية والعبرية، بعد طرح هذا الاقتراح من قبل مجلس الإشراف على فيسبوك المؤلف من خبراء خارجيين تموله الشركة، وذلك في أعقاب الحادث الذي أزال فيه المراجعون منشور كتبه مستخدم مصري يتضمن تقرير لقناة "الجزيرة" حول تهديدات باستخدام العنف من قبل الجناح العسكري لحركة حماس. وأعادت فيسبوك إظهار المنشور بالفعل.

في الواقع، لم يسبق لأحد أن قام بإدارة شبكة عالمية مثل شبكة فيسبوك التي تصل تقريبًا إلى كل بلد ولغة ومجتمع قائم على وجه الأرض. وتُظهر المستندات الخاصة بالشركة كيف أن الموظفين يعملون بمثابة أفراد في السلك الدبلوماسي لعصر الإنترنت، محاولين تطبيق علم البيانات على النزاعات الشائكة في العالم.

كما أوضحت المستندات أن الشركة تحاول إعطاء الأولوية للغة الإضافية وموارد الإشراف الآلي على المحتوى المعتدل لقائمة "البلدان المعرضة للخطر" حيث يُعتبر العنف أو غيره من أشكال الضرر الأكثر احتمالاً.

ولم يتضح بعد مدى اتساع "أنظمة الأتمتة" التي نشرتها فيسبوك للعديد من اللغات المدعومة في موقعها، أو كيفية مقارنة الأنظمة مع نظيراتها باللغة الإنجليزية. وفي عام 2019، صرحت فيسبوك لوكالة "رويترز" بأن لديها أنظمة آلية للبحث عن خطاب الكراهية عبر30 لغة والمحتوى الإرهابي عبر 19 لغة.

وبحسب ما جاء في المنشورات المتداولة داخل الشركة، عبّر بعض مهندسي فيسبوك عن تشاؤمهم الكبير إزاء قوة الأتمتة في حل مشكلات الشركة. كما تتوقع الوثيقة المنشورة عام 2019 أن تدريب المصنِف بشكل صحيح على اكتشاف الكلام الذي يحض على الكراهية في سوق يخدمه فيسبوك يتطلب 4000 عملية مراجعة يدوية للمحتوى يومياً.

وكان عالم البيانات لدى فيسبوك والذي عمل على "العنف والتحريض" قبل مغادرته الشركة في ديسمبر الفائت، توقع في منشور وداع له مُدرج ضمن مستندات هاوجين وتم الكشف عنه سابقاً أن الشركة تزيل أقل من 5 بالمائة من خطاب الكراهية عبر منصتها، مدعياً أن الذكاء الاصطناعي غير قادر على تحسين هذه النسبة بشكل كبير. وكتب عالم البيانات: "إن مشكلة استنتاج المعنى الدلالي للكلام بدقة عالية لن تُحل خلال وقت قريب".

ومع ذلك، أفادت فيسبوك بأن أرقام شهر يونيو أظهرت أن المعدل الوسطي العالمي لخطاب الكراهية الظاهر لمستخدمي فيسبوك انخفض بواقع النصف خلال الأشهر التسعة السابقة. لكن الشركة لم تُدلي بأي معلومات إزاء نماذج البلدان أو اللغات.

لكن عالم البيانات المغادر للشركة رأي أنه بإمكان الشركة تحقيق المزيد، مُشيرًا إلى أن الموظفين الذين يعملون على حل مشاكل المحتوى قد تم تفويضهم بمهام مستحيلة.

ووصف مؤلفو المنشور شعورهم الكبير بالذنب بسبب اضطرارهم لإعطاء الأولوية للعمل باللغة الإنجليزية الأمريكية، في وقت يندلع فيه العنف في أرمينيا وإثيوبيا، زاعمين أنه بإمكان فيسبوك اتباع طريقة سهلة للمساهمة في تحقيق الاعتدال في العالم.

وجاء في المنشور: "ليس من المعقول أن يكون هناك شخص واحد مسؤول عن علم البيانات الخاص بجميع أعمال العنف والتحريض في العالم بأسره"، موضحًا أنه "بإمكاننا تحمّل هذه المسؤولية وتوظيف المزيد من الأشخاص".

فيديو قد يعجبك: